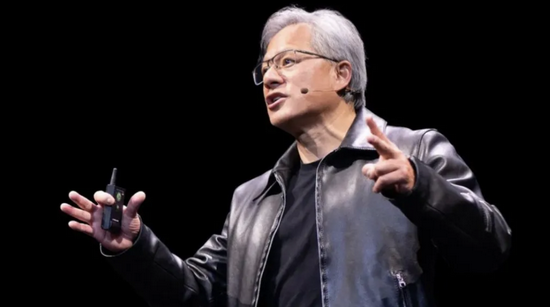

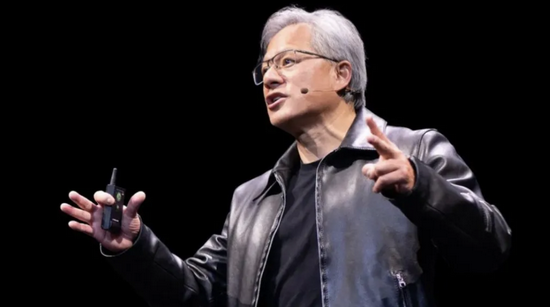

美国加州圣何塞SAP中心再次成为全球科技界的风暴眼。英伟达CEO黄仁勋身着标志性皮衣,在GTC大会开场演讲中抛出“AI超级碗”的宣言,并发布一系列颠覆性产品与技术路线图,这场被业界称为“算力领域分水岭”的发布会,不仅揭晓了下一代芯片架构Rubin和Feynman,更以“一年一更”的激进节奏,重新定义了AI基础设施的进化速度。

Blackwell Ultra与Rubin架构的“性能绞杀” 据悉,此次发布的重磅产品包括三部分。

一是GB300超级芯片。基于Blackwell Ultra架构,集成8颗GPU与3颗Grace CPU,晶体管数量突破3000亿个,较前代B200性能暴增150%,专为GPT-5级万亿参数模型训练优化6。

二是Rubin架构首秀。采用台积电2nm工艺,支持3D堆叠封装,显存带宽提升至8TB/s,可同时处理10亿级并发推理请求,目标直指实时AI搜索引擎与元宇宙渲染。

三是液冷超算集群。单机架搭载72颗GB300芯片,算力密度达到1.1 ExaFLOPS,训练1750亿参数大模型的能耗成本再降40%。

大会现场,微软、谷歌与亚马逊AWS已宣布首批采购GB300集群,用于构建下一代AI云服务。黄仁勋更直言:“到2027年,全球80%的AI算力将由英伟达架构驱动。”

超越DeepSeek R1:Llama Nemotron Reasoning发布在发布会上,NVIDIA还正式发布了其最新研发的推理模型——“Nvidia Llama Nemotron Reasoning”。黄仁勋自信满满地表示,这一新模型在准确性和速度两大关键性能指标上,均实现了对当前市场领先模型DeepSeek R1的“大幅超越”。

据悉,在准确性方面,Llama Nemotron Reasoning模型表现出了卓越的性能。根据英伟达提供的数据,该模型在多个标准测试集上的表现均优于DeepSeek R1,尤其是在处理复杂推理任务时,其准确性提升尤为显著。这一优势使得Llama Nemotron Reasoning模型能够更准确地理解和回答用户的问题,提供更智能、更可靠的服务。

而在速度方面,Llama Nemotron Reasoning模型同样表现出色。英伟达表示,该模型在GPU上的推理速度远超DeepSeek R1,能够更快地处理用户请求,降低延迟,提升用户体验。这一特性对于需要实时响应的应用场景尤为重要,如自动驾驶、在线客服、智能语音助手等。

黄仁勋在发布会上强调,Llama Nemotron Reasoning模型的卓越表现得益于英伟达在AI技术领域的深厚积累和不断创新。他表示,英伟达一直致力于推动AI技术的发展,通过不断优化算法和架构,提升模型的性能和效率。而Llama Nemotron Reasoning模型的发布,正是英伟达这一努力的最新成果。

掀起人形机器人革命 继去年推出机器人开发平台Isaac后,英伟达此次祭出“王炸级”产品——GR00T-N1通用人形机器人模型。

其中,GR00T-N1通用人形机器人拥有自然指令理解,通过视觉-语言联合训练,精准解析“将舞台左侧的米奇人偶移动到聚光灯下”等复杂指令;物理仿真训练,依托Omniverse数字孪生平台,机器人动作学习效率提升1000倍,迪士尼已将其应用于乐园服务机器人开发;边缘算力模组,推出Jetson Thor 2.0计算单元,功耗仅15W却支持实时环境建模,特斯拉Optimus、Figure 01等主流厂商已全面接入。

黄仁勋在现场展示了与迪士尼合作的成果,一台搭载GR00T-N1的机器人精准复刻了《冰雪奇缘》中雪宝的舞蹈动作。

黄仁勋表示,机器人的优点是可以与物理世界互动。我们非常清楚地知道,未来世界上将缺乏人类工人,到目前这个十年的末尾,世界上将至少有5000万劳动力短缺,(机器人)将是一个非常大的产业。未来生产的基础设施将是机器人,每辆车也都是机器人。

免责声明: 凡注明来源本网的所有作品,均为本网合法拥有版权或有权使用的作品,欢迎转载,注明出处。非本网作品均来自互联网,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。